Группировка по ТОПу — добавить основные параметры для запросов: частота, ГЗ, коммерциализация

Группировка по ТОПу — добавить основные параметры для запросов: частота, ГЗ, коммерциализация

Инструмент: https://tools.pixelplus.ru/tools/gruppirovka

Добавить для запросов следующие параметры:

- Частота по Вордстат

- Геозависимость (да / нет)

- Локализация (%)

- Коммерциализация (%)

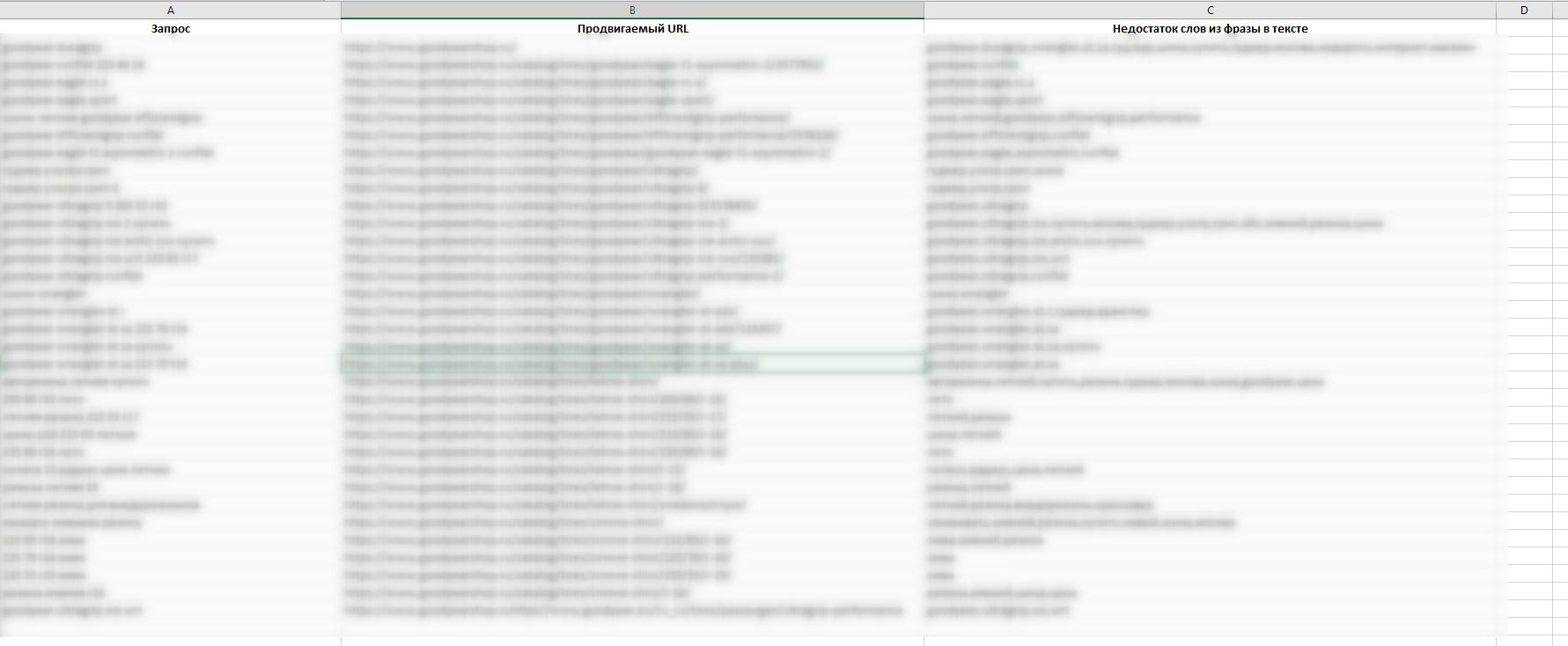

Пример итогового CSV:

распределение

Аудит поведенческих факторов — объединять протоколы http/https для суммирования трафика

Аудит поведенческих факторов — объединять протоколы http/https для суммирования трафика

Инструмент: https://tools.pixelplus.ru/tools/metrika-audit

Добавить в настройки инструмента чек-бокс «объединить протоколы http/https».

При активном чек-боксе суммировать трафик для одного документа с разными протоколами.

Например, для таких случаев: https://prnt.sc/l7fdol

Интеграция инструментов в модуль ведения проектов

Интеграция инструментов в модуль ведения проектов

Работая в модуле ведения проектов поймал себя на мысли, что можно ненавязчиво интегрировать ссылки на конкретные полезные инструменты внутри системы (по-моему вообще никак не используется сейчас).

Мега-простой пример (можно продумать, как еще упростить жизнь пользователям и сохранить их внутри системы):

1. Проект с объемным СЯ (условно, ~20т фраз) и съем ведется по 5+ поисковикам (версии сайта, регионы)

2. Чтобы не тратить слишком много лимитов, сделали авто-съем 1 раз в неделю (раз в 2 недели).

3. На сайте создали 3 новые страницы и создали Группу URL, где порядка 20 фраз.

Чтобы узнать, какие прямо сейчас позиции у запросов (условно, в быстророботе куда попали или владелец бизнеса интересуется), нужно:

а) Скопировать фразы и пойти искать, где снять актуальные позиции онлайн, в Инструменты Тулс, или вообще на другой ресурс через поисковик.

б) Кликнуть на "Проверить/Обновить позиции проекта" и ради 20 фраз потратить ооочень много лимитов.

И, лично мне, показалось идеальным прямо на детальной странице группы URL предложить ссылка на инструмент "Быстрый чек позиций", куда автоматически бы подгрузился список запросов конкретной группы с переходом на новую вкладку, или вообще в pop-up.

В группах URL это может быть актуально для таблиц:

- Позиции по запросам в группе «ХХХХ»

- Список запросов в группе «ХХХХХ»

Что это даст:

1. Можно быстро узнать позиции конкретной группы URL сэкономив время и лимиты.

Наверняка можно еще какие-то сервисы интегрировать в модуль ведения проектов.

2. Скорее всего большинство пользователь вообще не идут искать нужный Инструмент здесь: https://tools.pixelplus.ru/tools/, а начинают поиск в какой-нибудь Яндексе. Таким образом мы удерживаем пользователя и предлагаем ему потратить чуть-чуть лимитов внутри системы, в максимально целевом для него сервисе.

Добрый день.

Спасибо за обратную связь. В будущем году постараемся такие кнопки в проектах реализовать, как минимум для наиболее популярных задач (проверка позиций, текстовый анализ, расширение СЯ и т.д.). Следите за новостями на сайте https://tools.pixelplus.ru/news/ или в Telegram-канале https://t.me/pixeltools.

Дизайн интерфейса

Дизайн интерфейса

Господа! Вам выпала уникальная возможность мгновенного увеличения количества пользователей! Потратьте денег на изменение интерфейса....понимаю, что здесь дело привычки... для постоянных пользователей все просто и привычно, но должно же быть движение вперед!

Когда выбирал систему с которой работать, просмотрел все и остановился на seranking, т.к. показалась самой удобной и симпатичной. Смотрел и Вашу, но уж больно все уныло и не удобно (не говорю про функционал...просто про удобство просмотра информации и возможности трансформации результатов в нужном виде)...

В основном надо обратить внимание на отчеты, которые отправляются Заказчику. Они должны быть удобны в редактировании и просты для восприятия.

Большая просьба пересмотреть интерфейс системы! Посмотрите, как сделано у лучших и сделайте еще лучше! Мы же русские! На нас весь мир смотрит))

Автоформирование Excel-ТЗ на SEO-правку страниц проекта по результату отчета о внутренней оптимизации

Автоформирование Excel-ТЗ на SEO-правку страниц проекта по результату отчета о внутренней оптимизации

Все вышеописанное можно сделать руками, но автоматизация будет очень полезная.

-

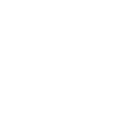

Экспортный файл, полученный на вкладке "Распределение" можно преобразовать за 30 секунд руками в вид файла ниже путем удаления ненужных строк и столбцов, сортировки и покраски через SEO-Excel (покраска необязательна для алгоритма, но помогает ручной/визуальной отработке). Это подготовка.

В результате обработки этого файла можно получить новые листы с конкретными действиями по конкретным точкам для изменений по URL.

Эти новые листы - очень ясное и простое руководство к действию и его легко отдать в работу для специалистов, вносящих правки.

-

Лист по недостаткам Title

-

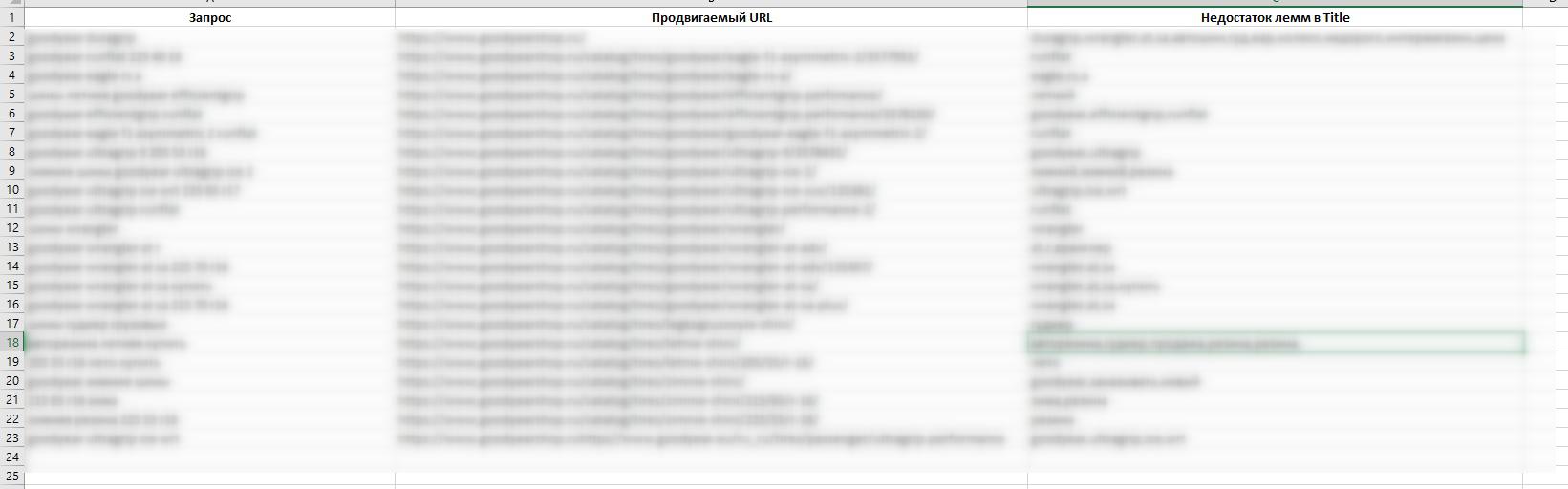

Лист по недостаткам H1

Для тега H1 рекомендуется проводить проверку на 200 код отклика.

Система выдает "Отсутствует" даже если URL'а просто нет.

-

Лист по недостаткам внутри текста

-

Желательно 2 режима:

1) Анализировать ТОЛЬКО те запросы, у которых Соответствие URL дает Да

2) Анализировать все запросы вне зависимости от соответствия URL

-

P.S. Сначала хотел сделать просто VBA-Макрос для преобразования файла, но такое решение все-таки костыль, плюс любое изменение в сервисе приведет к неработоспособности макроса.

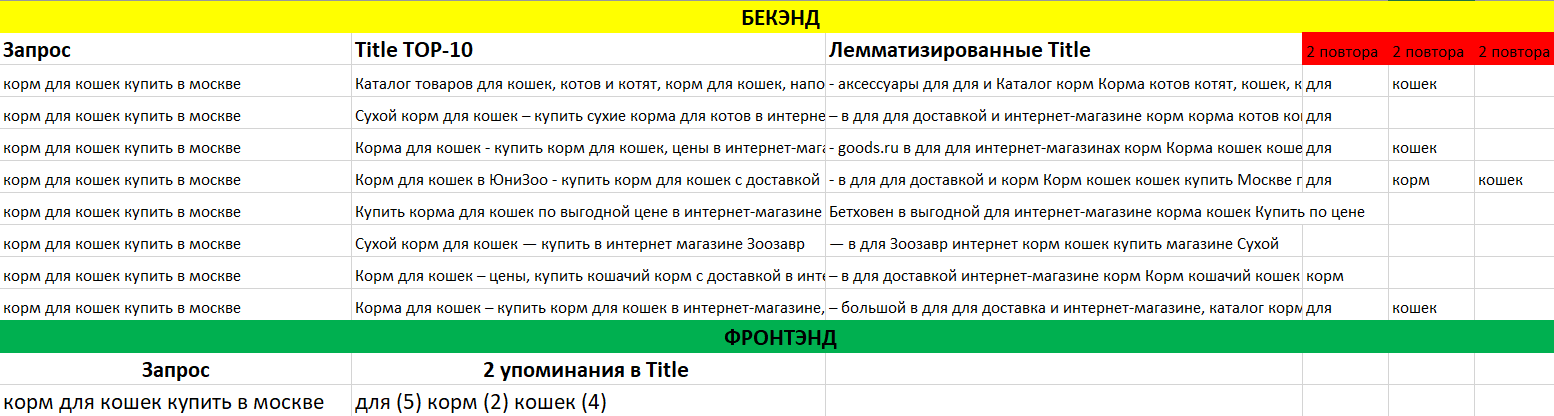

Вывод допустимой повышенной плотности слов в Title на основании ТОПа

Вывод допустимой повышенной плотности слов в Title на основании ТОПа

Основная задумка - предоставлять информацию по запросу о том какие слова из запроса допустимо уплотнить (упомянуть 2 раза) в заголовке Title на основании того факта, что конкуренты в выдаче в основном так делают.

Бекэнд:

1) Снимаем Title топ-10

2) Лемматизируем Title

3) Анализируем какие слова входят в Title каждого URL из 10

4) Смотрим количество упоминаний каждого слова

5) Делаем агрегированные данные по повышенному упоминанию каждого слова

Фронтэнд:

6) Выдаем результат в дополнительный столбец позапросного анализа

-----

Дальнейшие улучшения:

1) Выжимать из результата анализа служебные леммы (предлоги, союзы, цифры и прочее)

2) Сделать не позапросный анализ, а по URLловый, где в бекенде агрегируются данные по набору запросов, которые выделены в распределении в одну группу (с проверкой на соответствие продвигаемого URL и релевантного, если релевантный есть)

3) Сделать привязку к запросу/запросам - Выводить только те уплотненные леммы, которые уже есть внутри анализируемого запроса/группы запросов.

4) Сделать анализ исключительно по набору тех URL, встречающихся в выдаче, которые являются прямыми конкурентами продвигаемого проекта (для ИМа - только анализ тайтлов ИМов - без агрегаторов). (набор URL доменов, соответствующих продвигаемому проекту будет загружаться 1 раз SEOшником на основании другого анализа и затем периодически обновляться, когда в выдаче будут появляться новые домены, которые надо разметить)

5) Наоборот - показывать леммы, которые есть у конкурентов хотя бы 1 раз, и которых нет у продвигаемого проекта. Будет работать как сигнал об упущенном сегменте семантики, под который конкуренты продвигают страницу, а мы нет.

6) Добавить к анализу агрегированные данные о положении слов внутри Title у конкурентов (или тяготение к началу/концу). Например если у всех в топ-10 слово "Купить" идет первым словом, а у продвигаемого проекта - последним или в середине (или просто 6-ым по порядку), то сервис может предоставить информацию об этом. (пока даже в теории не представляю как реализовать, но думаю что это возможно)

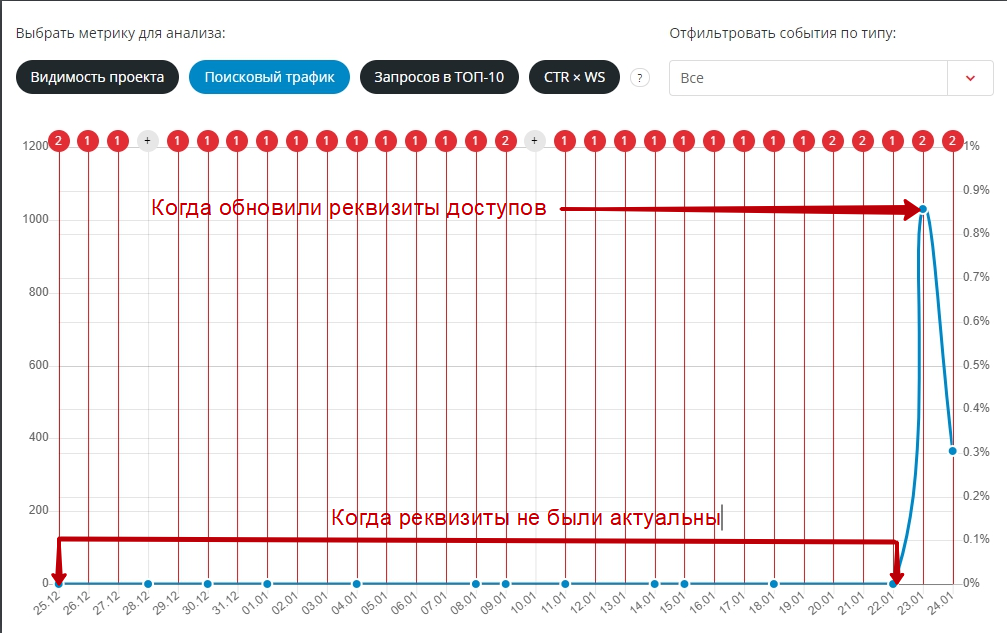

Забирать ретроспективные данные посещаемости из Метрики во внутренний график

Забирать ретроспективные данные посещаемости из Метрики во внутренний график

Если у проекта слетели реквизиты доступа и потом их обновили - график трафика все равно показывает только те данные, которые появились в момент обновления данных, хотя метрика вполне предоставляет данные о посещаемости за весь период.

Эти данные вполне можно тянуть ретроспективно, чтобы увидеть картину прошлого.

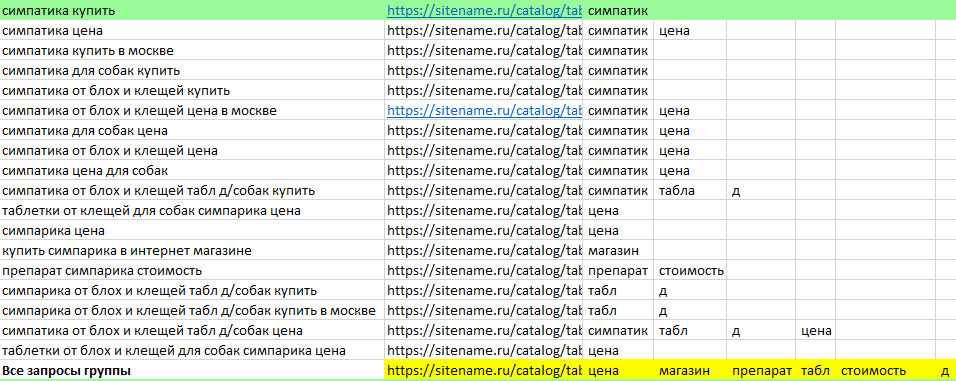

Вывод недостающих лемм в Title с привязкой к URL (в дополнение к привязке "по слову")

Вывод недостающих лемм в Title с привязкой к URL (в дополнение к привязке "по слову")

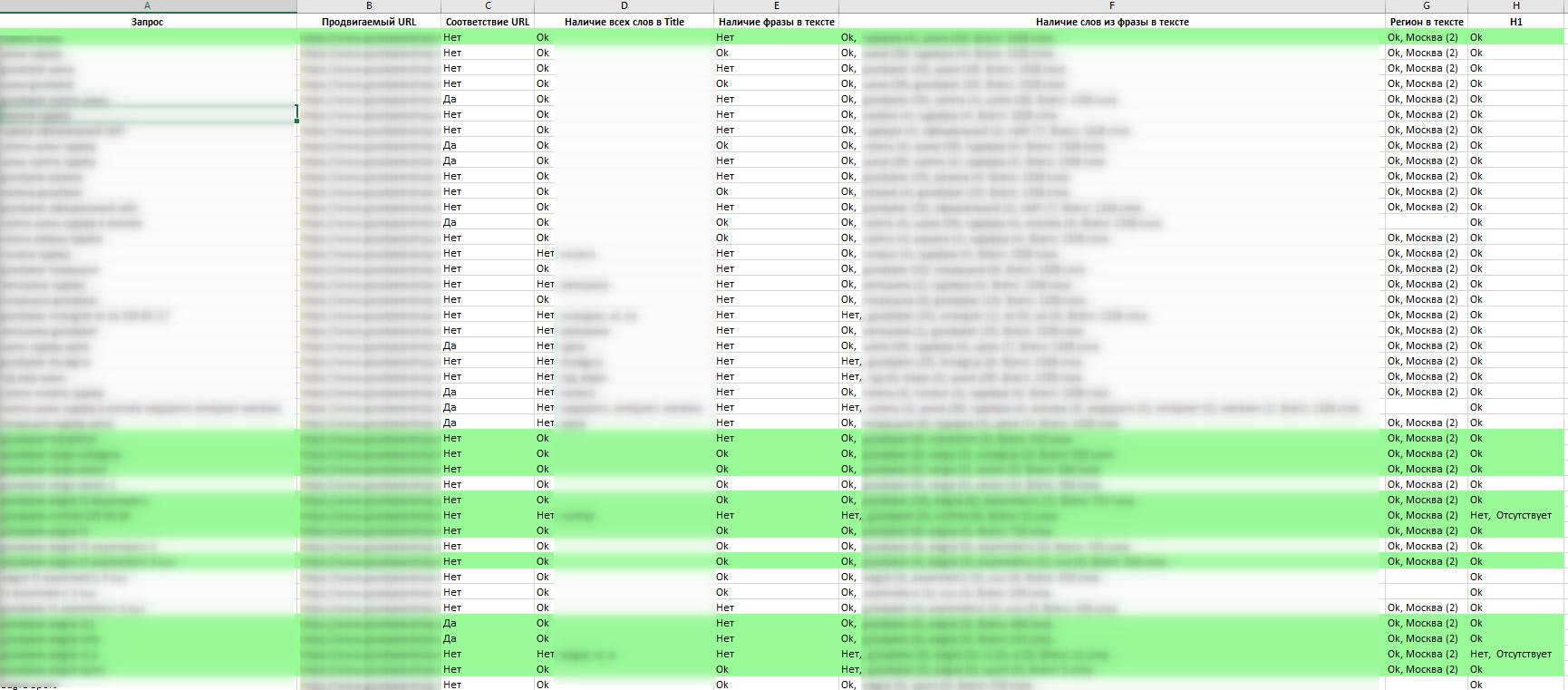

Сейчас экспорт файла распределения по части недостатков Title дает информацию с привязкой к запросу.

На URL посажено множество запросов, каждый из которых делает вклад в информацию о том, какие слова отсутствуют в Title URL (при опоре на группу запросов, заточенных под этот URL)

В связи с этим стоит давать информацию по недостаткам title URL относительно группы запросов

Потому что запросов в группе много и недостающих слов много от каждого запроса. А Title для всех запросов группы - один.

P.S. Надо определиться от кого отталкиваться - от релевантных или от продвигаемых URL (или от их совпадения)

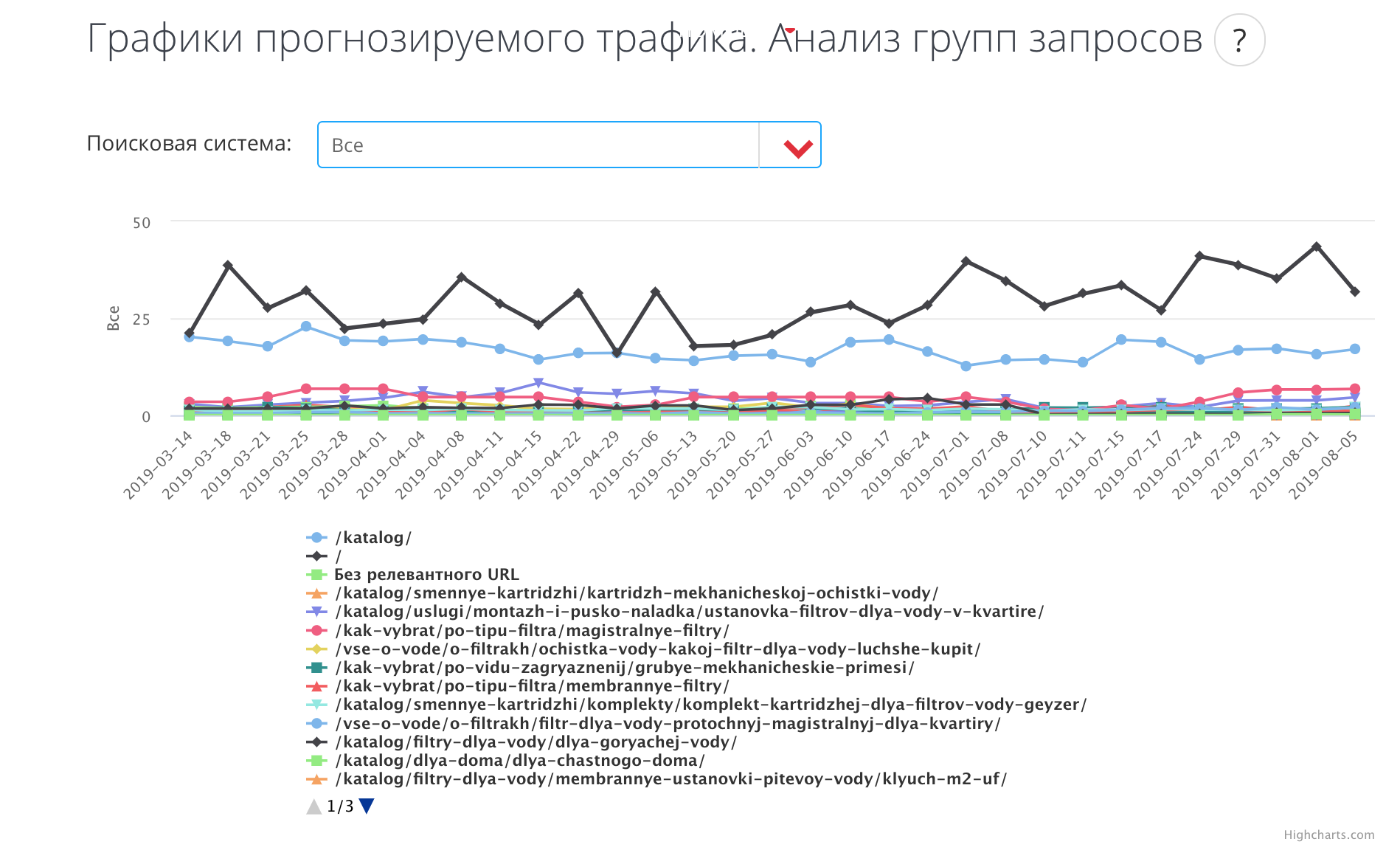

Графики прогнозируемого трафика по группам запросов растянуть по вертикали

Графики прогнозируемого трафика по группам запросов растянуть по вертикали

Очень мелкий масштаб по вертикали не позволяет визуально оценить сразу несколько групп, хорошо растянуть график вертикально и сделать на оси ординат большее количество интервалов (6-10), как например на графике Суммарной частоты всех запросов.

Во-вторых, было бы неплохо указывать группы в табличке по суммарному трафику за все дни. В таком случае самые востребованные группы будут отображаться в верхней части таблицы, а не на второй-третьей странице, как сейчас на моем проекте, см. скрин.

Это особенно важно при разбивке групп по целевым страницам.

Сервис поддержки клиентов работает на платформе UserEcho